美国佐治亚大学公共管理与政策副教授、统计学兼职助理教授及人工智能研究院兼职研究员 L. Jason Anastasopoulos 与哈佛大学肯尼迪学院阿什中心(Ash Center)博士后研究员 Jie Jason Lian 近期联合发表的一项研究提出:AI 并不是是威权统治的万能武器,无法克服“独裁者校准困境”(the autocrat’s calibration dilemma),这是任何概率预测系统自身都无法避免的结构性缺陷。

这项研究指出,任何概率预测系统都存在一组无法解决的矛盾:降低风险阈值可减少“漏网之鱼”(假阴性,或真实威胁),但误伤无辜者(假阳性,或非真实威胁)的情况势必增多;提高风险阈值可减少误伤,但势必增加“漏网之鱼”和监测盲点。

这种结构性缺陷并不会因为算法升级或数据库扩大而消失。

有三套自动机制会加剧“独裁者校准困境”。其一是自主性权衡(autonomy trade-off),给算法越高的自主权,计算速度越快和覆盖范围越大,发生误判的政治代价越大;即使微小的统计误差,也会产生沉重的政治负担。引入人工审核来限制算法自主权可以纠偏,但又产生官僚瓶颈,抵消了AI的效率优势。

其二是算法刻板性(algorithmic rigidity),模型是基于历史数据训练,假设过去的行为模式能预测未来威胁。但民众也会主动适应大数据监控,比如发明新暗语、换平台、转入加密通讯等,导致模型迅速过时,陷入持续被动的重新校准。

其三是稀有事件问题(rare-events problem),真正活跃的异见人士是少数,就算监控模型准确率高达 99%,但是要从一万人里面揪出一个真实威胁,那就意味着有 100 人会被当成锁定目标,这意味着 99 个人都会被抓错。但如果监控对象是 100 万人,那就有 1 万人会被错误锁定……这就会形成危险的反馈循环:安全部门被海量的虚假“命中”淹没,附带压迫不断伤及无辜,结果就会不断地扩大社会不满和削弱政权自身合法性,反而真正的威胁淹没在数据噪音之中。

“独裁者校准困境”会产生一种“阈值鞭打”(threshold whiplash)效应:政治敏感时期收紧社会控制,然后又突然放松、清理和宣传修复,如是循环。

熟悉中国政治的读者应该不陌生,即使中共当局也承认存在另一个问题:一管就死,一放就乱。“阈值鞭打”效应在一定程度上解释了这种微观“治乱循环”或“松紧循环”。

两位研究者以“动态清零”期间的健康码监控系统为例,解释了僵化的阈值控制分界线(digital cutoff)如何造成监控系统像“鞭打”(whiplash)一样反复来回震荡。

健康码系统的高敏感筛查机制,造成了大量“误伤”,无辜者被无缘无故隔离,无法申诉、无法辩解。这种情况积累了大量社会怨愤。紧接着,河南村镇银行储户维权事件中,官员为阻止民众赴郑州抗议,远程将储户健康码改为红色,这暴露出健康码系统并不是中立的公共卫生工具,而是可以被任意拨弄的政治开关。这样一来,整个健康码系统的公信力和心理威慑基础就动摇了,造成了潜在的合法性危机。在反封控运动(或“白纸运动”)期间,社会怨愤达到无法压制的临界点之后,监控系统实际上发生了系统性瘫痪。于是就出现了行政上放松管控措施,但政治上收紧打压一些讨论、抗议或纪念行为:不是政策真的转向了,而是在维持政治控制的前提下,对已经无法持续的行政僵化做出被动调整。

两位研究者进一步提出:由 AI 实施的数字监控的僵化性(rigidity)并不会产生社会稳定,反而滋生不稳定。甚至可以说,监控技术越精密,反而说明系统越脆弱——因为它以阈值僵化性换取了监控覆盖面,失去了治理社会所需的弹性与情境感知能力。除了中国的白纸运动之外,香港、俄罗斯和伊朗等抗议案例也同样表明数字监控无法压制社会反抗,而是促使反抗转型了——真正能压制反抗的是暴力,不是技术手段。

为什么 AI 技术手段无法解决这个“独裁者校准困境”呢?

两名研究者认为,不管怎么提升算力都无法克服稀有事件的算术逻辑,也就是假阳性悖论会始终存在,始终会有附带压迫波及无辜者,最终累积民怨。“古德哈特定律”(Goodhart’s Law)告诉我们:当某个指标成为监控目标,人们就会调整行为绕开它,导致指标失效,监控陷入“概念漂移”(concept drift)。再有就是,威权体制自身也会扭曲数据,因为数据会被官员当成自己的政治资本,官员会捏造或篡改数据来夸大监控系统的可靠性(以此作为自己的政绩),最终产生“垃圾进,垃圾出”(garbage in, garbage out)的问题。尤其这些被扭曲的数据汇报给领导人时,还会对领导人产生严重误导(不要以为汇报给领导人的内部资料一定是真实信息)。

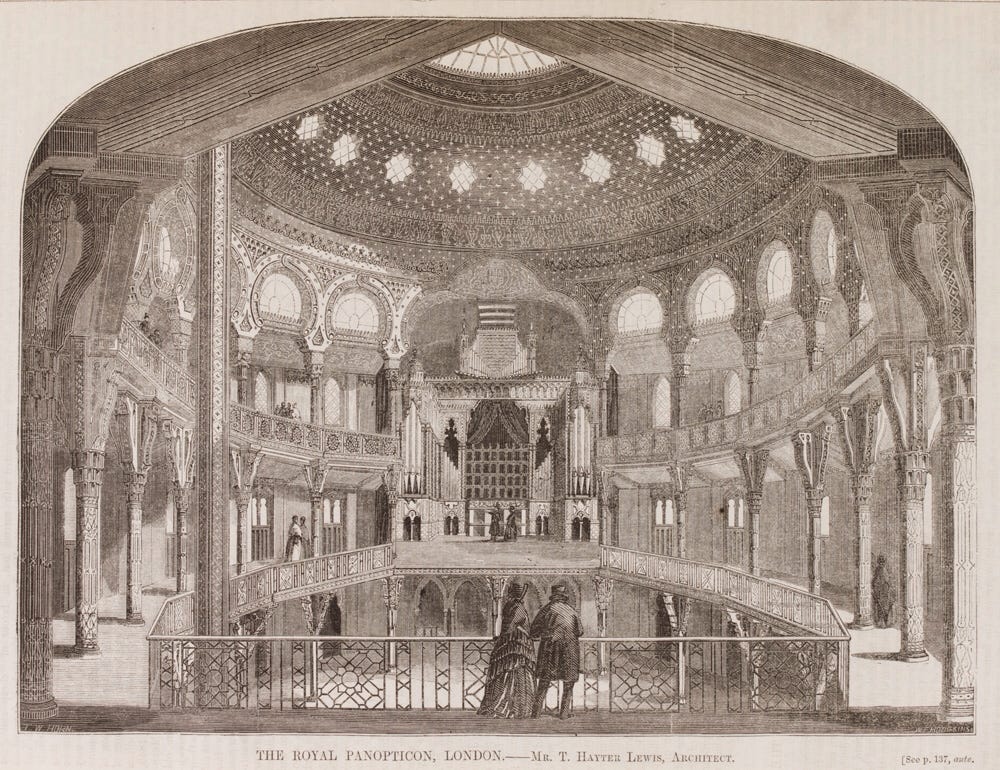

于是两位研究者指出:AI 的实际能力 ≠ 人们对它实际能力的认知。这就像边沁提出的“全景监狱”一样:一名守卫,理论上可以随时监视任何一名囚犯。持续不断的监视本身并不那么重要——更重要的是让被监视者相信:自己随时可能正处于监视之下。于是被监控者就产生了自我审查,而这个自我审查就是独裁政权的“数字红利”或“独裁者红利”:独裁者实际上没有强迫每个人服从的监控能力,但被监控者却因恐惧和自我审查而主动服从并夸大独裁者的监控能力。

两位研究者指出,全景式监狱威胁带来的稳定是相当脆弱的,因为依赖经济学家提木尔·库兰(Timur Kuran)提出的“偏好伪装”(preference falsification):民众表面上佯装忠诚,内心却暗藏怨恨;由此产生的顺从表象会误导统治者,使其无法察觉真实的不满程度。

随着反抗手段和策略不断升级,独裁政权与民众之间博弈也会呈现一个动态的过程。关于“算法厌恶”(algorithm aversion)的研究还表明,人们一旦观察到算法犯错,其服从意愿就会降低,而算法的虚张声势就暴露无遗了。

一旦人们普遍意识到国家监控会被海量“噪音”淹没、挤占真正的“信号”,而且存在大量监控盲区,恐惧就会迅速转变为愤怒。到那时,政权手中的监控系统将在技术上严重过载,在心理上彻底失去威慑力。

*上文主要内容源于:L. Jason Anastasopoulos and Jie (Jason) Lian, “The Limits of Authoritarian AI,” Journal of Democracy 37, no. 2 (2026): 5-17.